L’intelligenza artificiale non è simile all’intelligenza umana

È facile cadere nell’errore di umanizzare l’intelligenza artificiale. C’è chi immagina di fare amicizia con Siri o Alexa, oppure che la sua auto a guida autonoma abbia a cuore i suoi migliori interessi. Nell’immaginario comune, un’intelligenza artificiale viene spesso rappresentata come una macchina in grado di “apprendere” nello stesso modo in cui può farlo un bambino, di “pensare” o giungere a conclusioni simili a come questi meccanismi hanno luogo dell’essere umano. Anche il termine “reti neurali” – un algoritmo modellato sul cervello umano – fa apparire le decisioni prese da una macchina simili a quelle di un cervello umano.

Tuttavia, pensare che un’intelligenza artificiale funzioni allo stesso modo di un cervello umano può essere fuorviante e persino pericoloso, come afferma David Watson dell’Oxford Internet Institute e Alan Touring Institute in un recente studio su Minds and Machines.

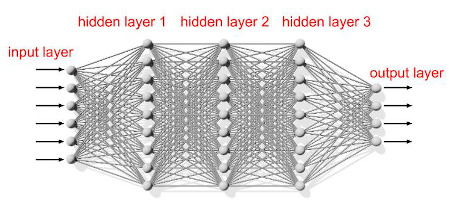

Uno dei più avanzati metodi “machine learning” è oggi rappresentato dalle reti neurali (il nome deriva dal funzionamento alla base dei neuroni e delle sinapsi all’interno del cervello). Una rete neurale artificiale riceve segnali esterni su uno strato di nodi (unità di elaborazione) d’ingresso, ciascuno dei quali è collegato con numerosi nodi interni, organizzati in più livelli. Ogni nodo elabora i segnali ricevuti e trasmette il risultato a nodi successivi. Si tratta – in sintesi – di un modello matematico/informatico di calcolo che emula le reti neurali biologiche.

Le reti neurali che contengono un gran numero di strati sono spesso chiamate reti neurali profonde (DNN) e sono alla base di sistemi quali Google Translate, il riconoscimento facciale di Facebook e Siri.

Senza dubbio, questi algoritmi sono potenti, ma ritenere che “pensino” e “apprendano” allo stesso modo degli umani sarebbe un errore, scrive Watson. Esistono molte differenze e lo studioso ne descrive almeno tre.

La prima: le DNN sono facili da ingannare. Ad esempio, immaginiamo di avere una foto di una banana: una rete neurale la classifica con successo come una banana. Tuttavia sarà sufficiente aggiungere una leggera quantità di rumore (disturbo visivo) o un’altra immagine oltre alla banana, e il DNN potrebbe ora pensare che la foto rappresenti un tostapane. Un essere umano non potrà mai essere ingannato da un simile trucco. Alcuni sostengono che ciò è dovuto al fatto che i DNN possono vedere cose che gli umani non possono, ma Watson afferma che “questa disconnessione tra reti neuronali biologiche e artificiali suggerisce che in quest’ultima è assente una componente cruciale essenziale per muoversi nel mondo reale“.

Seconda differenza: le DNN hanno bisogno di un’enorme quantità di dati per apprendere. Per giungere a riconoscere l’immagine di un cavallo, potrebbe essere necessario acquisire migliaia di immagini di cavalli prima di offrire un risultato stabile e inequivocabile, mentre un bambino sarà in grado di riconoscere il cavallo anche da un’immagine parziale dello stesso, dopo aver visto la sua foto solo poche volte. “Gli essere umani hanno una grande abilità al primo colpo d’occhio” scrive Watson, mentre insegnare a una rete neurale artificiale, d’altra parte, potrebbe essere molto difficile specialmente nei casi in cui è problematico raccogliere molti dati.

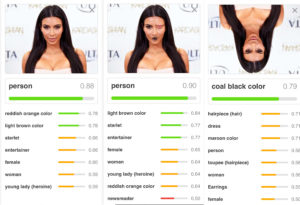

Terza differenza: le reti neurali sono “miopi”. Sono in grado, per così dire, di vedere l’albero ma non la foresta. A tale proposito, è interessante l’esperimento eseguito da Nick Bourdakos di IBM nel 2017. A una rete neurale è stata mostrata l’immagine di una nota attrice, la quale è stata subito riconosciuta come donna dello spettacolo; successivamente nell’immagine è stato scambiato un occhio con la bocca e la DNN non ha trovato nulla di strano, continuando a riportare la stessa assegnazione. È stato però sufficiente capovolgere l’immagine affinché la DNN non fosse più in grado di assegnarla come “donna” o “essere umano” (vedi figura).

Un altro esempio fondamentale: un essere umano potrà sempre dire “che la nuvola sembra un cane“, attingendo alle proprie capacità intuitive e alla sua immaginazione, mentre una DNN non sarebbe mai in grado di fare associazioni e metafore simili.

“Sarebbe un errore affermare che questi algoritmi ricreano l’intelligenza umana“, afferma Watson. “Introducono, invece, una nuova modalità di inferenza che in alcuni casi ci supera – in un certo senso – mentre in altri è molto carente“.

L’intelligenza artificiale viene sempre più utilizzata in settori quali finanza, medicina clinica e giustizia. Può essere utilizzata per determinare chi può ottenere un credito o chi può affittare una casa o beneficiare di un prestito. Quando la posta in gioco è alta, è necessario che coloro che prendono decisioni, siano essi macchine o umani, siano corretti, affidabili e responsabili. Gli algoritmi di machine learning e le reti neurali possono esserlo? Forse potrebbero essere corretti, ma possono davvero anche essere affidabili e responsabili? D’altronde è già difficile giudicare se un essere umano sia affidabile o responsabile, come può esserlo per qualcosa che “pensa” in modi radicalmente diversi dai nostri?

L’intelligenza artificiale (AI) è stata storicamente concettualizzata in termini antropomorfi. Alcuni algoritmi implementano progetti “bio-mimetici” nel tentativo deliberato di effettuare una sorta di isomorfismo digitale del cervello umano. Altri sfruttano strategie di apprendimento più generali che coincidono con le teorie della scienza cognitiva e dell’epistemologia sociale. Gli elementi di somiglianza delle reti neurali con la cognizione umana sono ampiamente sopravvalutati e interpretati in modo errato e l’impulso di umanizzare gli algoritmi è un ostacolo alla concettualizzazione corretta delle sfide etiche poste dalle tecnologie emergenti.

Gli algoritmi possono esercitare la loro azione (artificiale) solo a seguito di un contesto socialmente costruito in cui abbiamo deliberatamente concesso alcuni compiti alla macchina. Questo può essere più o meno ragionevole in diverse situazioni. Il software per filtrare le e-mail di spam è probabilmente ineccepibile; i sistemi automatizzati di condanna penale, d’altro canto, sollevano legittime preoccupazioni sulla natura e sul significato della giustizia in una società dell’informazione.

In ogni caso, il punto centrale – tanto ovvio quanto spesso viene trascurato – è che dovrebbero essere sempre gli umani a scegliere se rinunciare o meno alla propria autorità decisionale, a delegare a una tecnologia l’intervento per nostro conto.

Umanizzare l’intelligenza artificiale può risultare un’utile scorciatoia quando si spiegano modelli complessi a un pubblico senza un background minimo in statistica e informatica. Diviene fuorviante e potenzialmente pericoloso, tuttavia, quando viene utilizzato per guidare (o offuscare) il nostro giudizio etico. La tendenza a concentrarsi sulle affinità strutturali tra reti neurali biologiche e artificiali porta inevitabilmente verso un’interpretazione meccanicistica dell’intelligenza che non riuscirà mai a cogliere le complessità funzionali dell’intuizione umana.

“Gli algoritmi non sono certamente ‘come noi’…[] Antropomorfizzando un modello statistico, gli garantiamo implicitamente un grado di azione che non solo sopravvaluta le sue vere capacità, ma ci deruba della nostra autonomia … Sono sempre gli umani a scegliere se rinunciare o meno a questa autorità, autorizzare qualche parte della tecnologia ad intervenire per nostro conto. Sarebbe un errore presumere che questo trasferimento di autorità comporti una simultanea assoluzione della responsabilità. Non è così, la scelta, come sempre, è nostra. “ (D. Watson)

Molto interessante. Finalmente un discorso contrastante

Grazie!

concordo completamente.

E sicuramente molto interessante il punto di vista presentato da Marzocca, che mi trova assolutamente d’accordo, avendo io letto in precedenza le teorie di Roger Penrose sull’argomento, che già nei primi anni novanta escludeva in modo categorico tale ipotesi. Lo stesso (Penrose) sostiene che nel cervello umano, pensieri e decisioni vengono generati in una modalità che non risponde ad alcun algoritmo prestabilito e pertanto assolutamente non computabili, e tanto basta, almeno allo stato delle nostre attuali conoscenze.