Tecnologia digitale: allacciare le cinture di sicurezza!

Per limitare i rischi e le insidie derivanti dalla tecnologia digitale, occorre affrontarla con comportamenti e modalità in grado di controllarla. «Invece di lasciare che la tecnologia “intelligente” diminuisca le nostre capacità intellettuali, dovremmo imparare a controllarla meglio, fin dall’infanzia» dice Gerd Gigerenzer, Direttore del “Max Planck Institute for Human Development” in Berlino.

La tecnologia che pensavamo di utilizzare per rendere la vita più efficiente ha iniziato invece a usare noi stessi già da molto tempo. Sta ora tentando di rimodellare il nostro comportamento sociale in schemi che ricordano la società totalitaria ipotizzata da George Orwell in “1984”.

La rivoluzione digitale offre una vasta gamma di possibilità: migliaia di applicazioni, l’Internet of Things e una connettività quasi permanente. Ma nell’eccitazione generale e nell’illusione di onnipotenza che ne deriva, una cosa è stata facilmente dimenticata: la tecnologia innovativa ha bisogno di utenti competenti che possano controllarla piuttosto che esserne controllati e subirne le conseguenze.

La tecnologia che pensavamo di utilizzare per rendere la vita più efficiente ha iniziato invece a usare noi stessi già da molto tempo. Sta ora tentando di rimodellare il nostro comportamento sociale in schemi che ricordano la società totalitaria ipotizzata da George Orwell in “1984“.

Siamo bombardati da “utili raccomandazioni” su istruzione, salute, relazioni, tasse e tempo libero – abbinate ai nostri profili utente – che ci spingono verso prodotti e servizi per renderci “migliori cittadini consumatori”.

Vediamo tre semplici esempi:

- Uno studente siede al suo computer e sembra essere immerso nella stesura della sua tesi. Allo stesso tempo la sua casella di posta elettronica è aperta tutto il giorno e sembra proprio stia aspettando di essere interrotto. È infatti facile riconoscere quante interruzioni ha avuto nel corso della giornata osservando il flusso non lineare della sua scrittura. L’American Psychological Association ha rilevato in uno studio che il controllo costante dei dispositivi elettronici è una causa di stress significativo per la maggior parte delle persone.

- Un uomo scrive messaggi di testo mentre guida: “Quando arriva un testo, devo solo guardare, non importa cosa…“. Se, alla velocità di 50 chilometri all’ora, impiega solo 2 secondi per dare un’occhiata al suo cellulare, ha appena guidato 28 metri “ciechi”. Quell’uomo sta rischiando un incidente d’auto. Il suo smartphone ha preso il controllo del suo comportamento, come nel caso del 20-30% degli italiani che scrivono mentre guidano.

- Il professor Gigerenzer riporta che durante le elezioni parlamentari in India nel 2014 (le più grandi elezioni democratiche del mondo con oltre 800 milioni di potenziali elettori), c’erano tre candidati principali: N. Modi, A. Kejriwal e R. Ghandi. In uno studio, risultò che gli elettori indecisi cercarono maggiori informazioni su questi candidati utilizzando un motore di ricerca su Internet. Tuttavia, i partecipanti non sapevano che le pagine web erano state manipolate: gli elementi positivi su Modi apparivano nella prima pagina e quelli negativi in seguito. Questa e simili procedure manipolative sono pratiche comuni su Internet e si stima che per i candidati che compaiono nella prima pagina grazie a tale manipolazione, il numero di voti che ricevono dagli elettori indecisi aumenta di 20 punti percentuali.

In ciascuno di questi casi, il comportamento umano è controllato dalla tecnologia digitale. Perdere il controllo non è una novità, ma la rivoluzione digitale ha aumentato la possibilità che ciò accada.

L’educazione al rischio digitale significa essere in grado di sfruttare le tecnologie digitali senza diventarne dipendenti o manipolati da esse.

Cosa possiamo fare? Ci sono tre visioni concorrenti. Una è il “tecno-ottimismo“, che sostituisce il giudizio umano (ritenuto imperfetto) con gli algoritmi. Il distratto dottorando potrebbe continuare a leggere le sue e-mail e utilizzare un software di scrittura automatica della tesi; tutto quello che avrebbe bisogno di fare è inserire in rete le informazioni chiave sull’argomento. Tali algoritmi risolverebbero il fastidioso problema degli scandali di plagio, rendendoli così un comune fatto quotidiano!

Sebbene possa apparire che siamo nel campo della fantascienza, il giudizio umano è già stato sostituito da programmi per computer in molte aree. L’applicazione BabyConnect, ad esempio, tiene traccia dello sviluppo quotidiano dei neonati: altezza, peso, numero di volte in cui è stato allattato, quanto spesso i suoi pannolini sono stati cambiati e molto altro ancora, mentre le nuove applicazioni confrontano il bambino con i figli degli altri utenti in un database in tempo reale. Per i genitori, il loro bambino diventa un vettore di dati e le normali discrepanze spesso causano preoccupazioni non necessarie.

La seconda visione è conosciuta come “nudging“. Piuttosto che lasciare che l’algoritmo faccia tutto il lavoro, le persone sono guidate in una direzione particolare, spesso senza esserne consapevoli. È noto che la prima pagina dei risultati di ricerca di Google riceve circa il 90% di tutti i clic e metà di questi sono sui primi due risultati. La conoscenza di questo comportamento viene sfruttata manipolando l’ordine dei risultati in modo che quelli positivi su un particolare candidato o un particolare prodotto commerciale appaiano sulla prima pagina. In paesi come l’Italia, dove le ricerche sul web sono dominate da un singolo motore di ricerca (Google), questo porta a infinite possibilità di influenzare gli elettori o gli acquirenti. Come il tecno-ottimismo, il nudging prende il sopravvento sull’autonomia personale.

Tuttavia, esiste una terza possibilità: l’educazione al rischio digitale, in cui le persone vengono dotate delle competenze per controllare i media piuttosto che essere controllate. In generale, l’alfabetizzazione al rischio riguarda modi informati di trattare aree a rischio come salute, denaro e tecnologie moderne. L’educazione al rischio digitale porta ad essere in grado di sfruttare le tecnologie digitali senza diventarne dipendenti o manipolati da esse.

L’apprendimento dell’auto-controllo digitale deve iniziare fin dall’infanzia, a scuola e anche dall’esempio dei genitori; gli utenti possono imparare a gestire i rischi in modo più ragionevole e questo percorso educativo è molto più semplice di quanto possa apparire. Si tratta, in definitiva, di apprendere alcune regole basilari degli impatti della vita digitale sul benessere, nonché incoraggiare usi appropriati e sani mediante poche regole comportamentali per individuare i tentativi di manipolazione e limitare la frequenza di interazioni in rete. Inoltre, sono facilmente configurabili “controlli parentali” sui motori di ricerca e sui dispositivi per bloccare l’accesso dei bambini a contenuti inopportuni. L’American Academy of Pediatricsriferisce in uno studio che il benessere giovanile, la connessione sociale e l’empatia sono in pericolo nella vita digitale.

C’è voluto quasi un secolo per capire il rischio connesso con automobile e motocicletta: oggi – però – allacciare una cintura di sicurezza o indossare un casco sono diventati gesti quotidiani a cui nessuno fa più caso. Molti decenni sono stati necessari anche per capire che un impianto elettrico casalingo non può fare a meno di un buon circuito di terra e di un interruttore differenziale. Dall’immissione incontrollata di una tecnologia sul mercato sono quasi sempre seguite – a distanza di tempo variabile – opportune misure di salvaguardia del rischio introdotto dalla tecnologia stessa. Nel caso del digitale, i tempi di reazione dovrebbero essere proporzionati alla sua velocità di crescita: essendo quest’ultima esponenziale, l’educazione al rischio deve avvenire altrettanto rapidamente.

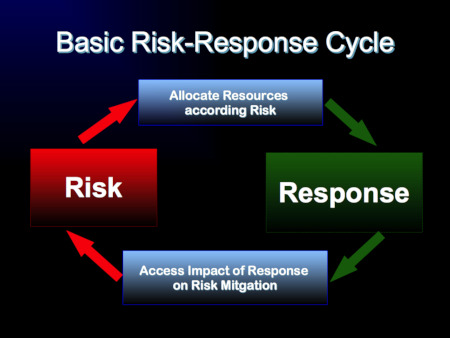

La gestione del rischio è diventata negli ultimi anni una disciplina molto sviluppata, dotata di teorie, metodi e processi per valutare e mitigare i rischi, principalmente (ma non solo) in queste aree: finanza, ambiente, salute, trasporti. In qualunque settore di attività umane viene sempre introdotto un approfondito studio di valutazione e mitigazione del corrispondente rischio con appropriate procedure di educazione, prevenzione e organizzazione. È sorprendente, invece, come nel settore della tecnologia digitale tutto ciò non sia affatto preso in considerazione, lasciando ciascuna persona libera di incorrere in situazioni di notevole rischio psico-fisico senza alcuna informazione o educazione in merito, se non la capacità naturale di giudizio di alcuni.

La gestione del rischio è diventata negli ultimi anni una disciplina molto sviluppata, dotata di teorie, metodi e processi per valutare e mitigare i rischi, principalmente (ma non solo) in queste aree: finanza, ambiente, salute, trasporti. In qualunque settore di attività umane viene sempre introdotto un approfondito studio di valutazione e mitigazione del corrispondente rischio con appropriate procedure di educazione, prevenzione e organizzazione. È sorprendente, invece, come nel settore della tecnologia digitale tutto ciò non sia affatto preso in considerazione, lasciando ciascuna persona libera di incorrere in situazioni di notevole rischio psico-fisico senza alcuna informazione o educazione in merito, se non la capacità naturale di giudizio di alcuni.

Il rapporto Global Risks 2018 del World Economic Forumelenca le “conseguenze negative dei progressi tecnologici” come una delle maggiori cause di rischio sociale del mondo moderno. Nel rapporto, questi rischi sono definiti come “conseguenze negative intenzionali o non intenzionali dei progressi tecnologici come l’intelligenza artificiale, la geoingegneria e la biologia sintetica che causano danni umani, ambientali ed economici“.

Alcune organizzazioni sensibili al problema del controllo tecnologico digitale sugli utenti (Università, Istituti, Associazioni, ecc.) hanno più volte tentato di delineare le azioni che andrebbero intraprese a livello governativo per introdurre una sorta di “etica della tecnologia digitale” o una “innovazione responsabile“, privilegiando l’essere umano rispetto al potere commerciale. Purtroppo queste azioni sono rimaste prive di interesse da parte di chi stabilisce le regole del mercato. In alcuni casi, addirittura noti filosofi sono stati in qualche modo “cooptati” dalle grandi industrie per cercare di diffondere messaggi positivi riguardo l’uso innocuo dell’intelligenza artificiale in rete.

A questo proposito, il sociologo Douglas Massey dell’Università di Princeton ha recentemente scritto: «Non sono molto ottimista sul fatto che i governi democraticamente eletti saranno in grado di regolare Internet e i social media in modo da beneficiare i molti utenti piuttosto che le poche industrie, date le enormi quantità di denaro e potere che sono in gioco. Le organizzazioni intergovernative sono troppo deboli a questo punto per avere qualche speranza di influenza. L’abrogazione della neutralità della rete da parte dell’amministrazione Trump non è certamente un buon segno».

Il rapporto Global Risks 2018 del World Economic Forum elenca le “conseguenze negative dei progressi tecnologici” come una delle maggiori cause di rischio sociale del mondo moderno.

Non potendo pertanto ridurre i rischi attraverso un’opportuna regolazione normativa della valanga incontrollata di tecnologia digitale in rete, occorre necessariamente ricorrere a un’opportuna educazione dell’utente che sia in grado di evidenziare le maggiori problematiche di rischio e suggerire le conseguenti azioni di mitigazione dello stesso.

Alex Halavais, direttore del Dipartimento di Tecnologie Sociali dell’Università dello Stato dell’Arizona, ha dichiarato: «Il cambiamento primario deve avvenire nell’istruzione. Sin dalla più tenera età, le persone hanno bisogno di capire come interagire con le tecnologie digitali in rete: devono imparare come usare (e come non usare) i social media. Hanno bisogno di capire come assemblare informazioni affidabili e come individuare invece le false notizie e gli specchietti per le allodole. Devono essere consapevoli di come gli algoritmi e il marketing – così come le aziende, i governi e le altre organizzazioni che li producono – contribuiscano a modellare e mistificare la loro visione del mondo. Sfortunatamente, dall’asilo alla scuola superiore, non c’è ancora molto consenso su come raggiungere questo obiettivo.»

Come diceva Stephen Hawking, riprendendo una delle tesi più famose di Socrate, «il più grande nemico della conoscenza non è l’ignoranza, è l’illusione della conoscenza». E in questo, la Rete è davvero pericolosa perché ci fornisce l’illusione di sapere senza studiare, di scegliere senza usare il libero arbitrio e di esprimere un parere senza bisogno di scomodare lo spirito critico.